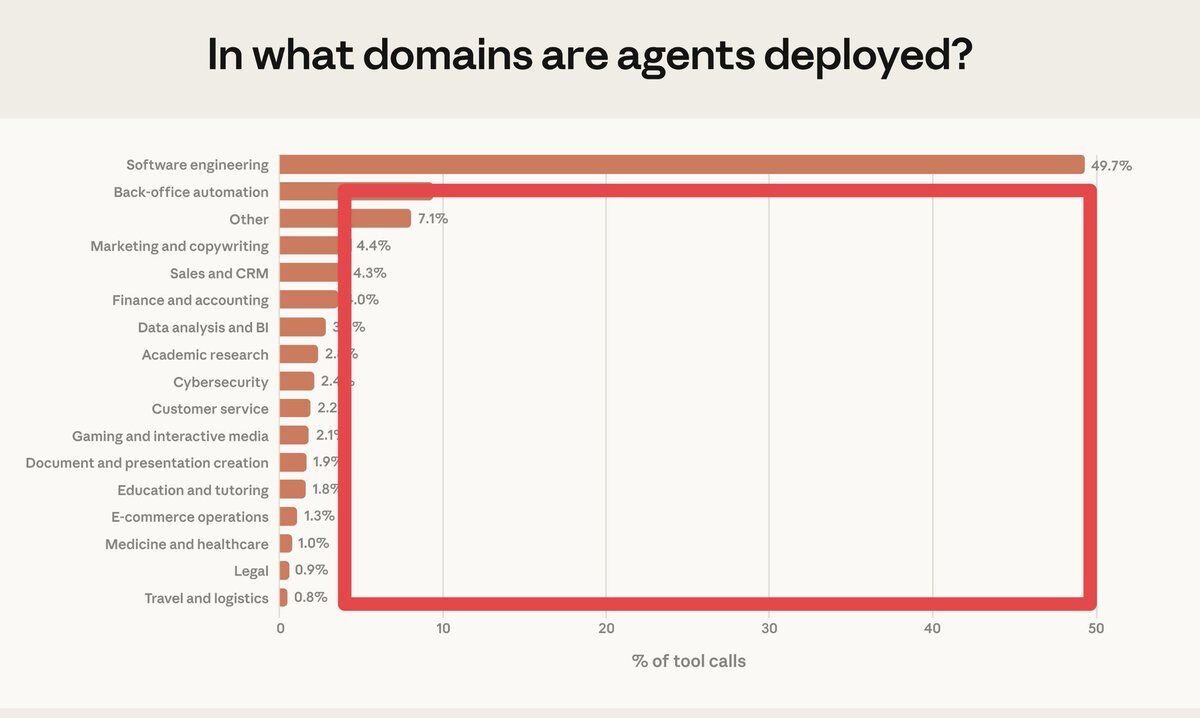

Anthropic оприлюднила масштабне дослідження використання AI-агентів у реальних сценаріях. Дані показують: майже 50% усіх agentic tool calls припадає на розробку програмного забезпечення. Інші 16 вертикалей — від медицини до освіти — мають частку менше ніж 9% кожна. Більшість — взагалі нижче 5%.

Фактично software engineering контролює 49,7% активності агентів через API Anthropic. Для порівняння: охорона здоров’я — близько 1%, юридична сфера — 0,9%, освіта — 1,8%. Це не перенасичені сегменти. Це сегменти, які ще майже не сформувалися.

Anthropic називає це найбільш повним дослідженням практичного використання AI-агентів. І головний висновок для засновників стартапів звучить просто: майже весь простір поза розробкою ПЗ — greenfield.

Розрив між можливостями та довірою

Окремо дослідження звертає увагу на «deployment overhang» — розрив між тим, що моделі вже здатні робити, і тим, наскільки користувачі готові їм довіряти.

Згідно з оцінками METR, Claude може виконувати завдання, на які людині потрібно майже п’ять годин. Однак на практиці 99,9-й перцентиль сесій триває лише близько 42 хвилин.

З жовтня 2025 до січня 2026 року максимальна тривалість сесій Claude Code майже подвоїлася — з менш ніж 25 хвилин до понад 45 хвилин. Причому зростання відбувалося плавно між релізами моделей. Це свідчить не лише про покращення якості моделей, а й про поступове накопичення довіри користувачів.

Як зазначають автори дослідження:

«З серпня до грудня рівень успішності Claude Code у виконанні найскладніших внутрішніх завдань подвоївся, тоді як середня кількість людських втручань за сесію зменшилася з 5,4 до 3,3».

Довіра як навичка

Цікава закономірність: нові користувачі автоматично схвалюють близько 20% сесій Claude Code. Після приблизно 750 сесій цей показник перевищує 40%.

Водночас досвідчені користувачі частіше переривають агентів: новачки втручаються у 5% кроків, а досвідчені — у 9%. Це не суперечність, а зміна стратегії. Початківці перевіряють кожну дію наперед. Досвідчені делегують більше, але активно моніторять і втручаються лише за потреби.

Anthropic формулює ключову тезу: автономність агента — це не властивість моделі як такої. Вона формується спільно моделлю, користувачем і продуктом.

«Автономність агентів на практиці є спільно сконструйованою — моделлю, користувачем і продуктом. Claude обмежує власну незалежність, зупиняючись для уточнень у разі невизначеності. Користувачі поступово змінюють стратегію контролю в міру зростання довіри».

Безпека та реальні ризики

Дані виглядають відносно безпечними: 73% викликів інструментів відбуваються з людиною в контурі прийняття рішень. Лише 0,8% дій є незворотними.

Найризикованіші сценарії — як-от автономна торгівля криптовалютою чи ексфільтрація API-ключів — здебільшого використовуються в межах тестування безпеки, а не у продакшені.

Anthropic також застерігає від надмірного регулювання:

«Вимоги, які зобов’язують людину схвалювати кожну дію, створюють тертя без обов’язкового підвищення безпеки».

Де шукати нових «єдинорогів»

Якщо SaaS за останні десятиліття зростав у 10 разів кожне десятиріччя та породив понад 170 «єдинорогів», то наступною хвилею можуть стати vertical AI-компанії.

Логіка проста: кожен SaaS-єдиноріг має потенційний vertical AI-аналог. І ці компанії можуть бути в рази більшими, адже замінюватимуть не лише програмне забезпечення, а й частину операційної роботи.

Сфери з мінімальною часткою агентної активності — медицина, право, фінанси, освіта, логістика, клієнтський сервіс — фактично залишаються відкритими для гравців, які зможуть поєднати:

— доменну експертизу

— інтеграцію з пропрієтарними даними

— адаптацію до регуляторних вимог

— change management у великих організаціях

Для IT-ринку це чіткий сигнал: агентний AI уже довів ефективність у розробці ПЗ, але основна економічна цінність може виникнути в інших вертикалях. Дані Anthropic показують, що проблема не в можливостях моделей, а в їх впровадженні.

Розрив між п’ятьма годинами потенційної автономної роботи й фактичними 42 хвилинами — це індикатор ранньої фази ринку. І це означає, що більшість vertical AI-продуктів ще навіть не почали з’являтися.

Читайте на ProIT: Apple з’ясувала, чого користувачі очікують від ШІ-агентів.

Підписуйтеся на ProIT у Telegram, щоб не пропустити жодної публікації!