Функція Google AI Overviews, яка працює на базі моделей Gemini і з’являється у верхній частині пошукової видачі Google, демонструє точність на рівні близько 90%. Водночас це означає, що приблизно одна з десяти відповідей є неправильною.

З урахуванням масштабу пошуку Google це перетворюється на сотні тисяч помилок щохвилини та десятки мільйонів неправильних відповідей щодня.

Дослідження провело видання The New York Times разом зі стартапом Oumi, який займається розробкою AI-моделей. Для оцінки використовувався тест SimpleQA — набір із понад 4000 запитань із перевірюваними відповідями. Його створила OpenAI у 2024 році для вимірювання фактичної точності генеративних моделей.

Перші вимірювання проводилися ще тоді, коли Gemini 2.5 була основною моделлю Google — тоді точність становила близько 85%. Після оновлення до Gemini 3 цей показник зріс до приблизно 91%.

Попри покращення, навіть такий рівень означає значну кількість помилок у реальному використанні. Якщо масштабувати ці результати на всі пошукові запити, система генерує десятки мільйонів некоректних відповідей щодня.

У звіті наведено конкретні приклади помилок. Наприклад, при запиті про дату відкриття музею в колишньому будинку Боба Марлі AI Overviews послалася на три джерела, з яких лише одне містило потрібну інформацію — і навіть там були суперечливі дані. Система обрала неправильний варіант.

В іншому випадку AI Overviews заявила, що не існує Зали слави класичної музики, хоча одночасно посилалася на сайт організації, де зазначалося, що віолончеліст Йо-Йо Ма був туди включений.

У Google не погоджуються з результатами дослідження. Представник компанії Нед Адріанс заявив, що тест SimpleQA містить неточності і не відображає реальні пошукові сценарії користувачів. За його словами, Google використовує власний варіант — SimpleQA Verified — із більш ретельно перевіреними запитаннями.

Оцінка точності AI-моделей залишається складною проблемою. Різні компанії застосовують різні методики, а самі моделі можуть давати різні відповіді на одне й те саме запитання при повторному запуску. До того ж у цьому дослідженні для тестування використовувалися інші AI-інструменти, які також можуть помилятися.

Ще один фактор — AI Overviews не є єдиною моделлю. Google використовує різні моделі залежно від запиту. Найточніші відповіді дають потужні моделі рівня Gemini 3.1 Pro, але вони повільні та дорогі. Тому на практиці часто застосовуються швидші версії Gemini Flash, які менш точні.

У самій компанії визнають, що точність у межах 90% для AI — це доволі високий показник. У багатьох тестах нові моделі демонструють лише 60–80% точності без доступу до зовнішніх джерел.

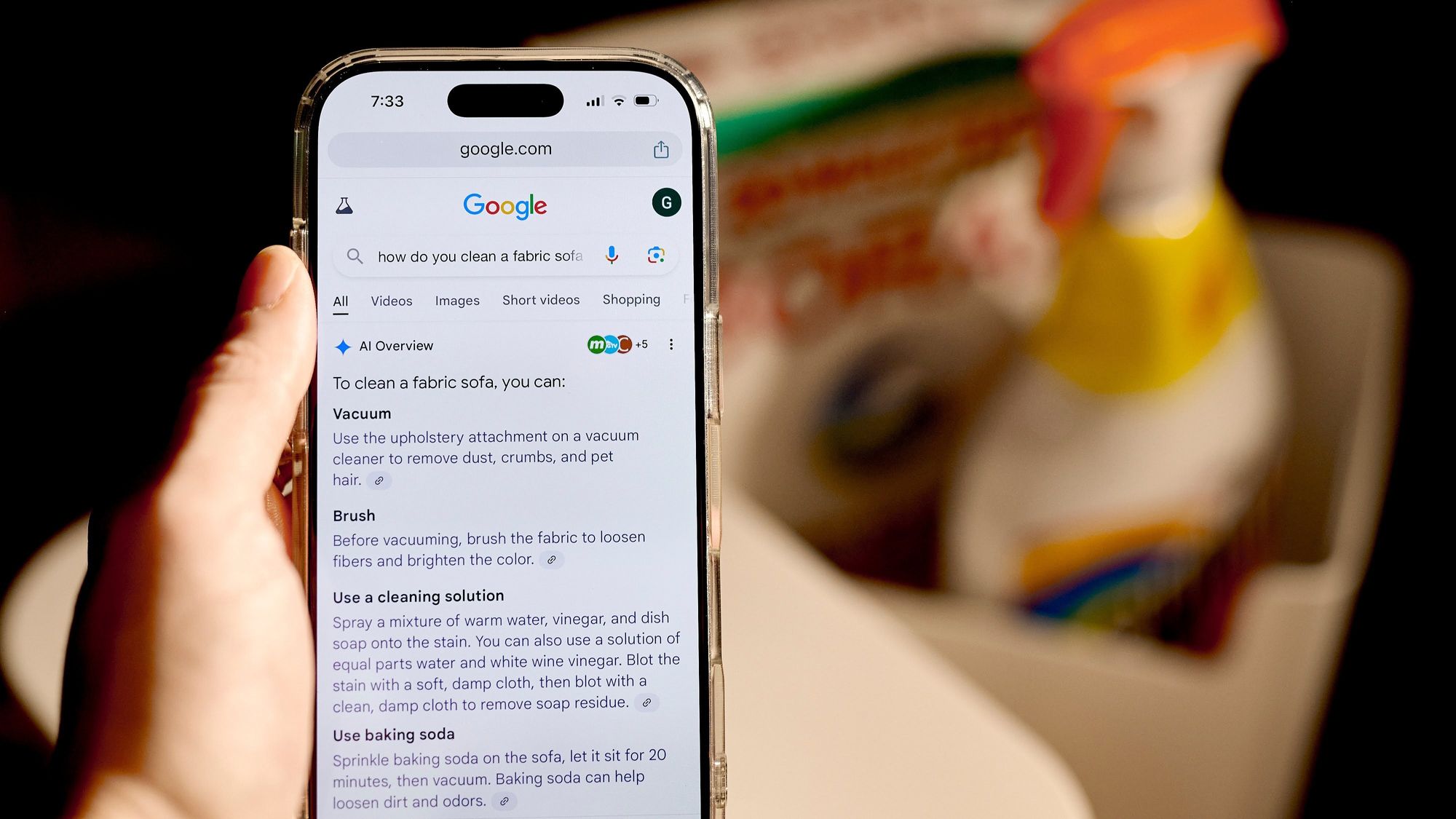

Водночас проблема полягає в поведінці користувачів. AI Overviews подає відповідь у вигляді готового резюме, що зменшує ймовірність переходу за джерелами. У результаті користувачі частіше сприймають відповідь як остаточну, навіть якщо вона містить помилки.

Google сама попереджає про це в інтерфейсі: «AI може помилятися, тому перевіряйте відповіді».

Читайте на ProIT: Anthropic опублікувала дослідження, у якому пояснила, чому мовні моделі іноді взаємодіють із користувачами так, ніби мають емоції.